5. НЕКОТОРЫЕ ВОПРОСЫ ТЕОРИИ ИНФОРМАЦИИ

Ранее подчеркивалась необходимость исследования неэлектромагнитного канала обмена информацией в природе с позиций комплексной области знаний теории информации, оперируя ее понятиями и уравнениями. Базисным тезисом в цепи понимания рассматриваемых информационных процессов является основополагающая взаимосвязь понятий энтропии и информации.

Великая формула Больцмана устанавливает логарифмическую зависимость между понятием энтропии и Lстатистическим весом состояния рассматриваемой системы¦:

S = k In P (9),

где S - энтропия,

k - постоянная Больцмана.

Р - так называемый статистический вес состояния системы.

Совершенно очевидно, что выявленное под влиянием информационных потоков различных знаков С речь идет о поглощении либо излучении информации в пространстве) изменение энтропии рассматриваемых рецепторных систем указывает на факт возможности получения различных величин энтропии (организованности вещества) одной и той же рассматриваемой рецепторной системы при неизменном значении параметра статистического веса состояния вещества [P]. Вследствие чего происходит изменение величины энтропии рассматриваемого рецептора под влиянием предложенного ему неэлектромагнитного информационного потока при отсутствии изменений характеризующего параметра его статистического веса? Уравнение Больцмана на этот важнейший вопрос ответа не дает! Однако не менее очевидна необходимость единой теоретической базы в рассмотрении информационных процессов электромагнитной и неэлектромагнитной природы. Поэтому следует ожидать, что полученные результаты исследований в области регистрирования неэлектромагнитного канала обмена информации в природе ни в коем случае не перечеркивают или опровергают традиционную (электромагнитную) концепцию современной теории информации, а лишь дополняют ее.

Каким же образом это дополнение выражается на примере уравнения Больцмана? Ответ на этот важнейший вопрос является тем основанием, на котором базируется Кибернетика будущего, рассматривающая как электромагнитный, так и совершенно равноценный ему, неэлектромагнитный канал обмена информацией в природе.

Уравнение Больцмана не рассматривает основание логарифмической функции (кибернетика Виннера, по крайней мере, принимает его равным двум). Великая формула поистине оказалась без основания! А ведь именно в этом, на наш взгляд, и заключается смысл этого самого дополнения.

В самом деле, как можно рассматривать логарифмику, не принимая во внимание ее основания. Это если и не абсурдно, то, по меньшей мере, не корректно с точки зрения математического анализа.Совершенно иное дело, что обнаружить физический смысл основания логарифмической функции, описываемой уравнением Больцмана, возможно лишь с привлечением неэлектромагнитного информационного канала. Безусловно, если традиционная теория информации каким-то образом обходилась без рассмотрения этого вопроса, то для описываемых информационных взаимодействий по существу имеет решающее значение.

Количество содержащейся в пространстве неэлектромагнитной информации определяет уровень энтропии всех веществ (тел). В свою очередь, само количество информации определяется всевозможными процессами (событиями), имевшими место в данной области пространства. Под термином пространственная область следует понимать умышленно выделенный объем пространства, варьируемый от помещения лаборатории до видимой границы метагалактики с учетом всех процессов, происходящих во времени.

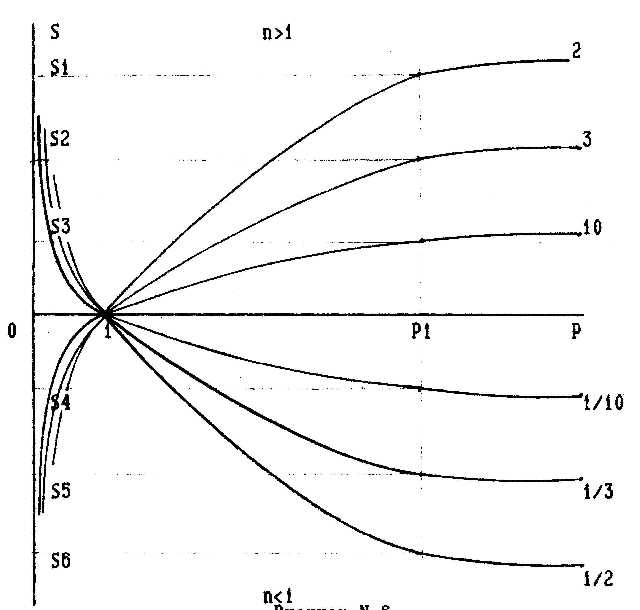

Чем больше количество неэлектромагнитной информации содержится в некоторой точке пространства, определяемой вышеназванной причиной, тем меньше уровень энтропии у находящихся в этой точке пространства материальных тел. По мнению H.A. Козырева, произведенный в пространстве некоторой причиной неэлектромагнитный информационный поток имеет ряд признаков. Во-первых, он способен мгновенно распространяться в пространстве (космосе), и. во-вторых, его действие (рецепция равноценными системами, находящимися на различных удалениях от источника информационного потока) ослабевает по закону, обратно пропорциональному квадрату расстояния. Рисунок N 6 показывает, что при одном и том же выбранном значении величины [Р] существует возможность наличия различных уровней энтропии одного и того же материального вещества (тела). Определяющее значение имеет величина показателя логарифмики. Следовательно, именно основание логарифмической функции определяет информационную насыщенность пространства. Причем, чем выше количество содержащейся в данной точке пространства информации, тем с большим основанием мы имеем логарифмическую функцию в уравнении Больцмана, определяющую уровень энтропии вещества, находящегося в этой области пространства. И, соответственно, наоборот. Чем меньше показатель логарифмики, тем выше энтропия вещества, находящейся в рассматриваемой области пространства при одном строго фиксированном показателе величины статистического веса состояния вещества [P].

Рисунок ¦6

Лагорифмика уравнения Больцмана

Таким образом, кибернетический смысл математического понятия основания логарифмической функции заключается в количестве содержащейся в некоторой точке пространства неэлектромагнитной (структурной) информации, по сути говоря, в информационной насыщенности фона, в котором имеют место различные события и процессы. Однако все вышеназванное относится к случаю, когда n>1. Каким же образом обстоит дело при n<1 (рисунок N б)? Следует подчеркнуть, что случай при основании логарифмики уравнения (9) больше единицы (n>1) описывает информационные процессы, связанные с излучением неэлектромагнитной информации в пространство. Поэтому, очевидно, при n<1 уравнение (9) соответствует случаю, характеризующемуся поглощением неэлектромагнитной информации из пространства, вызванным некоторой причиной.

Так, допустим, что в некоторой пространственной области имеет место процесс, характеризующийся сокращением собственной энтропии системы, например, кристаллизации. Под информационным влиянием этого процесса происходит поглощение некоторого количества информации из фона. Чем интенсивнее процесс кристаллизации, тем интенсивнее его потребление из пространства (фона) неэлектромагнитной информации, а следовательно, значительнее изменение (увеличение) энтропии различных веществ рецепторов, случайно находящихся в его близи. Чем интенсивнее поглощение (потребление) неэлектромагнитной информации из фона, вызванное некоторой причиной, тем меньше основание логарифмики уравнения (9) и тем больше энтропия различных рецепторов,Lподвергшихся¦ действию рассматриваемого информационного влияния.

Общим выводом является условие, при котором уравнение (9) с основанием логарифмики больше единицы описывает процессы, излучающие в силу определенных причин информацию в пространство и, как следствие, приводящие к определенному сокращению энтропии различных рецепторов, пространственно находящихся в их близи. В то же время уравнение (9) с основанием меньше единицы соответствует информационным процессам, протекающим с поглощением структурной информации из пространства, так же вызванным некоторой причиной, а следовательно, и приводящим к увеличению (в зависимости от интенсивности) энтропии рассматриваемых рецепторных систем.

Таким образом можем записать:

S = logn P (10).

Очевидно, что областью определения логарифмической функции есть (R+) - множество положительных чисел.

Отвечает ли этому требованию понятие статистического веса состояния системы? С точки зрения современной теории информации статистический вес состояния [P] - это не совсем обычная вероятность осуществления одного события из нескольких возможных, так как сумма простых вероятностей всех возможных событий всегда равна единице. Однако логарифм числа, меньшего единицы, отрицателен. Для того, чтобы избежать этого, традиционная теория информации трактует значение под логарифмом как некий статистический вес [Р] - число способов осуществления данного состояния рассматриваемой системы. В качестве наглядности можно привести пример бросания монеты, в данном случае статистический вес состояния будет соответствовать 2.

Этим, условно говоря, и достигается данное множеств положительных чисел. И то не всех, а лишь тех, которые больше единицы, и как же обстоит дело с подмножеством, меньшим единицы? Ответ прост. Никак. Оно просто не рассматривается, а ведь именно этому обиженному подмножеству области определения функции соответствует самая загадочная отрицательная область значения логарифмической функции. Ведь область значения данной функции есть все множество действительных чисел -... Илья Пригожин назвал отрицательную энтропию - негэнтропией, объективной реальностью современной науки.

Очевидно, что пресловутый Lстатистический вес¦ не отвечает требованиям, предъявляемым уравнением Больцмана?

Так какой же истиный, физический смысл имеет этот загадочный параметр [P]?

Только лишь количество неэлектромагнитной информации, содержащейся в данной точке пространства, определяет энтропию материальных тел (структур), находящихся вблизи нее? Конечно же, нет. Выше мы говорили, что термин количество информации весьма условен и состоит из огромного количества составлявших, если так можно сказать, подинформаций, порождаемых таким же количеством всевозможных процессов - событий. Каждая в отдельности подинформация имеет собственный уровень рецепции применительно к каждой конкретной рецепторной системе. Именно поэтому ценность информации, в данном случае - подинформаций, по отношению к всевозможным рецепторам является ключом к расшифровке этого некоего сгустка различных составляющих, неэлектромагнитной или структурной информации.

Рассмотрим это на конкретном примере. Закипающая на огне костра в туристическом котелке вода переходит в наиболее вероятное состояние, увеличивая собственную энтропию, при этом в окружающее пространство выбрасывается (излучается) свойственная ей информация, которая, суммируясь с уже имеющейся там информацией, порожденной совершенно иными причинами, является по отношению к ней подинформацией. Порожденная вышеописанной причиной подинформация способна быть воспринята (поглощена) всеми веществами или структурами, в том числе и биологическими: почвой, деревьями, растительным покровом, животными... И. соответственно, обнаружена по изменению собственной энтропии вышеназванных рецепторов. Совершенно очевидно, что для различных рецепторов будет обнаружена и различная степень восприятия предложенной им информации. Причем максимальной рецепции рассматриваемой информации следует ожидать у веществ, аналогичных веществу источника информационного воздействия, в приведенном примере у воды - в луже, реке, озере.

Таким образом, наряду с определяющим параметром количества информации, имевшейся в рассматриваемой области пространства, не менее важное значение для ее рецепции всевозможными потенциальными веществами рецепторами имеет ценность данной информации, применительно к каждому конкретному рецептору.

Каким же образом возможно математически описать понятие Lценности информации¦?

Вопрос о ценности информации исследовался многими отечественными учёными: M.М. Бонгардом, Р.Л. Стратоновичем, А.А. Харкевичем. Так, на наш взгляд, в заслуживавшей особого внимания книге Бонгарда [5] степень полезности сообщения (то есть ценности информации) связывается с увеличением вероятности достижения некоторой цели после получения сообщения, Можно представить ценность информации (V) формулой:

V = P / / Р (11) ,

где Р и Р /- вероятности достижения некоторой цели до и после получения информации.

Необходимо еще раз отметить, что ценность информации функционально связана с её рецепцией. Выяснение вопроса о ценности данной информации возможно лишь после решения некоторых последствий его восприятия рецептором. Иными словами, ценность данной информации проявляется в результатах рецепции, то есть она непосредственно связана с уровнем рецепции. Как следует из формулы (11),ценность информации (в отличие от статистического веса состояния вещества) может быть как больше единицы в том случае, когда вероятность достижения некоторой цели после получения сообщения (информации) больше по сравнению с вероятностью, имевшейся до этого сообщения (информации), так и меньше единицы в том случае, если вероятность достижения некоторой цели системой после получения сообщения (информации) меньше, чем до него. Совершенно очевидно, что выражение для ценности информации (11) удовлетворяет требованиям, предъявляемым логарифмикой уравнения Больцмана. Окончательно имеем:

S = logn V (12).

Представленная формула отвечает всем требованиям неэлектромагнитной теории информации (как, впрочем, и электромагнитной ее составляющей) и может стать базовой для создания неэлектромагнитной Кибернетики.